Latencja – czym jest i jak ją poprawić? Przewodnik na 2025 r.

Latencja to czas potrzebny na przesłanie danych z urządzenia do miejsca docelowego i z powrotem. Opóźnienie może sprawić, że Internet będzie działać wolno, zwłaszcza w przypadku czynności wymagających krótkiego czasu reakcji, takich jak granie online i wideorozmowy. Wysoka latencja może powodować lagi lub opóźnienia między tym, co robisz, a tym, co dzieje się na ekranie.

Redukcja latencji może przełożyć się na płynniejsze działanie Internetu. Czasem wystarczy kilka prostych działań, np. optymalizacja ustawień internetowych lub modernizacja sprzętu. W tym poradniku dowiesz się, czym jest latencja, co ją powoduje i jak ją poprawić. Uwaga od redakcji: Bardzo cenimy sobie relacje z czytelnikami. W naszych działaniach kierujemy się przejrzystością i uczciwością, dokładając wszelkich starań, by zasłużyć na Wasze zaufanie. Jako portal podlegamy pod tę samą grupę właścicielską co część czołowych produktów w branży, które recenzujemy. Dotyczy to Intego, CyberGhost, ExpressVPN i Private Internet Access. Nie ma to jednak żadnego wpływu na nasz proces oceny, ponieważ stosujemy rygorystyczną metodologię testowania.

Krótkie podsumowanie: czym jest latencja?

Latencja jest często mylona z przepustowością i pingiem, ale tak naprawdę są to trzy oddzielne terminy. Przepustowość oznacza ilość danych, jaką jest w stanie obsłużyć połączenie, podczas gdy latencja to całkowity czas, w jakim dane pokonują trasę w obie strony, z uwzględnieniem wszelkich opóźnień. Ping służy do pomiaru latencji – wysyła sygnał na serwer, aby zmierzyć czas transferu w obie strony.

Kiedy klikasz odnośnik lub wczytujesz film, żądanie trafia na serwer i wraca z zawartością. Czas potrzebny na wędrówkę danych w obie strony to latencja. Wysoka latencja może sprawić, że wszystko będzie działać wolno. Prowadzi to do opóźnień podczas streamingu, zakłóceń podczas wideorozmów i lagów w grach wideo. Latencję mierzy się w milisekundach (ms). Im niższa wartość, tym lepiej.

Rodzaje latencji

Latencja występuje w wielu formach, a każda z nich na różne sposoby wpływa na komfort korzystania z Internetu. Znajomość poszczególnych rodzajów może pomóc w określeniu przyczyny opóźnień i pozwala lepiej zrozumieć, w jaki sposób dane przemieszczają się w różnych systemach. Oto zestawienie głównych rodzajów latencji:

- Latencja sieci – opóźnienie w przesyłaniu danych przez sieć, na które wpływają odległość, przeciążenie sieci i ścieżki przekierowywania danych między urządzeniami.

- Latencja dysku – opóźnienie w dostępie do danych lub zapisywaniu ich na urządzeniu. Obejmuje czas wyszukiwania, opóźnienia rotacyjne i prędkość transferu.

- Latencja przetwarzania – czas potrzebny na interpretację i przetworzenie danych oraz sprawdzenie, czy zawierają błędy, przed wysłaniem ich przez sieć.

- Opóźnienie propagacji – czas transmisji sygnału przez medium, na który wpływa fizyczna odległość między podłączonymi urządzeniami.

- Opóźnienie transmisji – czas potrzebny na przesłanie wszystkich bitów pakietu danych do sieci, zależny od rozmiaru pakietu i przepustowości.

- Opóźnienie kolejkowania – czas oczekiwania na pakiet w kolejce, gdy urządzenie sieciowe przetwarza wiele pakietów danych.

- Latencja przerwania – odstęp czasu od momentu wygenerowania przerwania przez urządzenie do momentu rozpoczęcia jego obsługi przez procesor. Jest to istotne w systemach czasu rzeczywistego.

- Latencja światłowodu – minimalne opóźnienie w transmisji światłowodowej, na które wpływ ma prędkość światła przechodzącego przez przewód optyczny.

- Latencja połączenia internetowego – całkowite opóźnienie transmisji danych przez Internet obejmujące opóźnienie sieci, ścieżki routingu i czas przetwarzania przez serwer.

Latencja, szerokość pasma i przepustowość – czym różnią się te terminy?

Latencja, szerokość pasma i przepustowość w różny sposób wpływają na komfort korzystania z Internetu, oddziałując na prędkość połączenia, szybkość reakcji i zdolność przetwarzania danych. Wiedza o tym, jak poszczególne elementy ze sobą współdziałają, może pomóc w zidentyfikowaniu i rozwiązaniu problemów, które powodują obniżenie prędkości połączenia.

- Latencja – jest to opóźnienie w przesyłaniu danych z urządzenia na serwer i z powrotem, mierzone w milisekundach (ms). Wysoka latencja powoduje lagi w grach, zakłócenia podczas wideorozmów i ogólne spowolnienie różnych działań online. Latencję można sprawdzić, wykonując test pingu, który pokazuje opóźnienie między wysyłaniem i odbieraniem danych.

- Szerokość pasma – to maksymalna ilość danych, jaką może obsłużyć połączenie, mierzona w Mb/s lub Gb/s. Można ją porównać do szerokości autostrady – większa wartość szerokości pasma oznacza, że więcej danych może przemieszczać się w tym samym czasie. Szerokość pasma można zmierzyć za pomocą testów prędkości online.

![Zrzut ekranu z wynikiem testu szybkości Ookla.]() Z powodu przeciążenia sieci lub współdzielenia urządzeń prędkość połączenia może być niższa niż przepustowość

Z powodu przeciążenia sieci lub współdzielenia urządzeń prędkość połączenia może być niższa niż przepustowość - Przepustowość – rzeczywista ilość danych przesyłanych przez połączenie w czasie rzeczywistym. Mierzy się ją w Mb/s lub Gb/s i zależy od takich czynników jak przeciążenie sieci i ograniczenia sprzętowe. Przepustowość można zmierzyć, sprawdzając aktualne prędkości pobierania i wysyłania i porównując je z szerokością pasma.

Wymagania dotyczące latencji dla poszczególnych rodzajów aktywności w Internecie

Różne aktywności online mają różne wymagania dotyczące latencji, szerokości pasma i przepustowości. Skorzystaj z poniższej tabeli, aby poznać optymalne wartości.

| Aktywność | Latencja (ms) | Szerokość pasma (Mb/s) | Przepustowość (Mb/s) | Wpływ wysokiego poziomu latencji i niskiej przepustowości |

| Przeglądanie Internetu | <100 | 1-5 | 1-5 | Strony mogą ładować się wolniej; wyświetlenie obrazów i filmów może zająć więcej czasu |

| Streaming filmów i seriali | <100 | 3-25 | 3-25 | Problemy z buforowaniem; niższa jakość wideo; częste przerwy |

| Granie online | <50 | 1-3 | 1-3 | Lag, dłuższy czas reakcji, mało responsywna rozgrywka |

| Wideorozmowy | <150 | 1-4 | 1-4 | Opóźnienia audio/wideo; niska jakość; rozłączanie |

| Pobieranie plików | <200 | 5-50 | 5-50 | Niższe prędkości pobierania; dłuższy czas oczekiwania na ściągnięcie dużych plików |

| Aplikacje w chmurze | <100 | 1-10 | 1-10 | Opóźnienia synchronizacji danych; powolne działanie narzędzi do pracy zespołowej w czasie rzeczywistym |

Uwaga: tabela zawiera dane szacunkowe. Rzeczywiste wartości mogą się różnić w zależności od konkretnych zastosowań i uwarunkowań sieciowych.

Jak działa latencja?

Wszelkie działania podejmowane w Internecie wiążą się z koniecznością kilkuetapowego przesyłania danych między urządzeniem a serwerem. Chociaż komunikacja odbywa się z prędkością światła, każdy krok wprowadza niewielkie opóźnienie. Kiedy zsumujemy wszystkie opóźnienia, otrzymamy wartość latencji.

- Inicjowanie żądania: po kliknięciu odnośnika lub wysłaniu wiadomości urządzenie tworzy pakiety danych zawierające żądanie.

- Transmisja w sieci lokalnej: pakiety najpierw wędrują przez sieć domową, przechodząc przez router lub modem.

- Przekierowanie przez dostawcę usług internetowych: z routera dane trafiają do dostawcy usług internetowych, który przekierowuje je na serwer docelowy.

- Transmisja przez sieć szkieletową Internetu: dane wędrują przez główne ścieżki Internetu, prawdopodobnie przechodząc przez wiele routerów i sieci.

- Odbiór i przetwarzanie przez serwer: serwer docelowy odbiera pakiety, przetwarza żądanie i przygotowuje odpowiedź.

- Droga powrotna: serwer wysyła odpowiedź, wyznaczając ścieżkę powrotną na urządzenie użytkownika.

Co wywołuje latencję?

Każda forma opóźnienia ma swoją przyczynę: od fizycznej ścieżki przesyłania danych po zastosowaną technologię. Oto lista potencjalnych przyczyn występowania latencji:

- Rzeczywista odległość – im dłuższy dystans dane muszą pokonać między urządzeniem a serwerem, tym większe opóźnienie. Przykładowo, serwer zlokalizowany za granicą będzie generował większe opóźnienia w porównaniu z serwerem znajdującym się w twoim regionie.

- Przeciążenie sieci – gdy zbyt wielu użytkowników lub urządzeń korzysta z tej samej sieci, pakiety danych wędrują dłużej. Przeciążenie sieci jest powszechne w godzinach szczytu, spowalniając ogólną prędkość połączenia i zwiększając latencję.

- Ścieżki routingu – dane nie zawsze podążają najprostszą drogą z urządzenia do miejsca docelowego. Mogą zostać przekierowane przez kilka routerów lub sieci, a każdy dodatkowy etap powoduje niewielkie opóźnienie. Takie „przeskakiwanie” szczególnie przyczynia się do większych opóźnień na dużych odległościach.

- Medium transmisyjne – typ połączenia ma bezpośredni wpływ na latencję. Kable światłowodowe zapewniają najwyższe prędkości i najniższe opóźnienia, podczas gdy kable miedziane i połączenia bezprzewodowe są zwykle wolniejsze ze względu na fizyczne ograniczenia transferu danych.

- Ograniczenia sprzętowe – routery, switche i modemy mogą powodować opóźnienia, jeśli są przestarzałe lub przeciążone. Urządzenia niezoptymalizowane pod kątem szybkiego przetwarzania danych mogą stanowić wąskie gardło połączenia, spowalniając transmisję danych.

- Utrata pakietów – jeśli pakiety danych zostaną utracone lub porzucone podczas transmisji, muszą zostać wysłane ponownie, co zwiększa latencję. Najczęstszymi przyczynami utraty pakietów są błędy sieciowe, przeszkody fizyczne lub zakłócenia w połączeniach bezprzewodowych.

- Ustawienia QoS (z ang. Quality of Service; jakość usługi) – w niektórych sieciach stosuje się QoS, by nadawać priorytet określonym rodzajom ruchu, np. połączeniom wideo. Jeśli podejmowane działanie nie jest traktowane priorytetowo, mogą wystąpić większe opóźnienia, szczególnie w przypadku intensywnego korzystania z sieci.

Jak zmierzyć latencję sieci?

Latencja może istotnie wpływać na komfort korzystania z Internetu. Na szczęście istnieje kilka narzędzi, które precyzyjnie wskazują miejsca, w których występują opóźnienia. Oto lista metod pomiaru latencji:

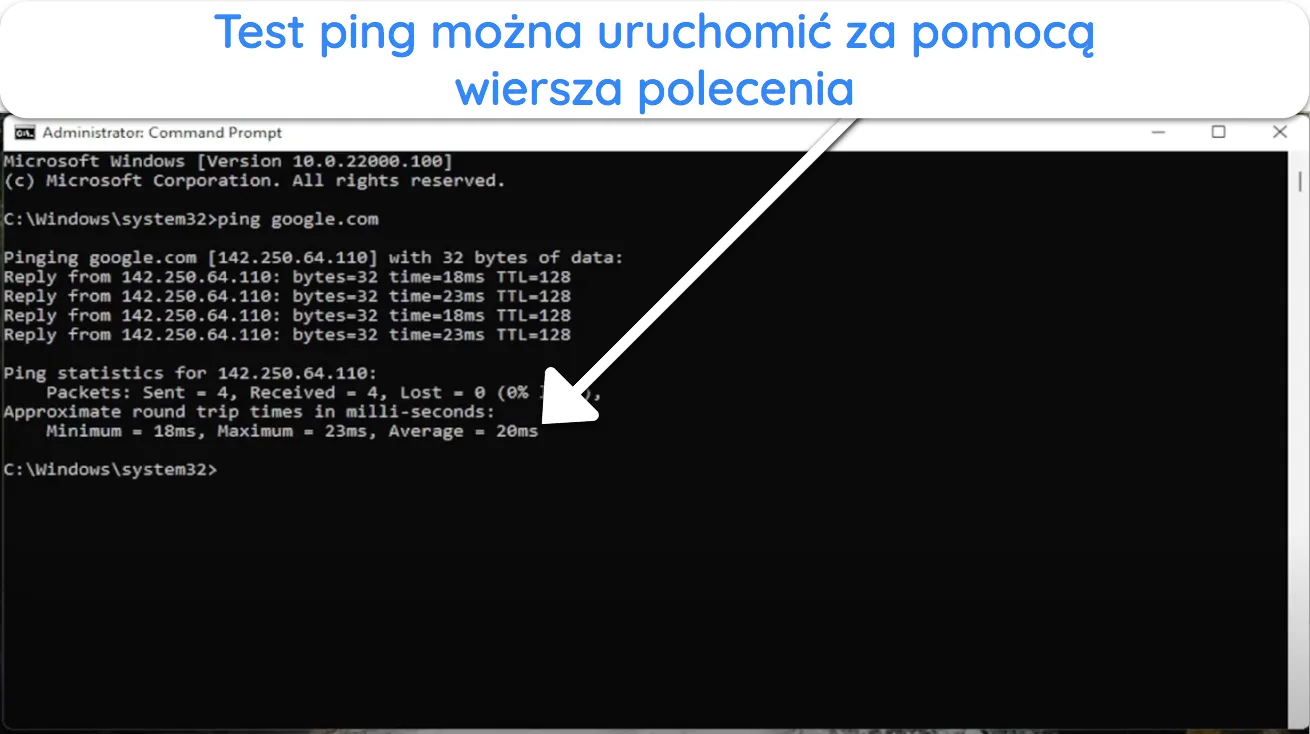

Ping

Ping to podstawowe narzędzie dostępne w większości systemów operacyjnych. Wysyła mały pakiet danych na serwer docelowy i mierzy czas potrzebny na powrót. Aby użyć tego narzędzia, otwórz wiersz polecenia lub terminal i wpisz „ping [target address]”, na przykład „ping google.com”. Wynik przedstawia czas podróży w obie strony w milisekundach.

Traceroute

Narzędzie mapuje ścieżkę, którą dane pokonują, aby dotrzeć do miejsca docelowego, przedstawiając każdy z etapów transmisji. Pomaga to zidentyfikować miejsca, w których występują opóźnienia. Aby je uruchomić, wpisz „tracert [target address]” w systemie Windows lub „traceroute [target address]” w systemach macOS i Linux, na przykład „tracert google.com”. Wynik przedstawia każdy przeskok i czas jego trwania.

TTFB (z ang. Time to First Byte – czas do pierwszego bajta)

Mierzy czas od momentu wysłania żądania do otrzymania przez przeglądarkę pierwszego bajtu danych z serwera. Obejmuje czas przetwarzania danych przez serwer i latencję sieci. Narzędzia do pomiaru wydajności sieci, takie jak Google PageSpeed Insights, mogą pomóc w pomiarze TTFB.

RTT (z ang. Round Trip Time – czas przesyłu w obie strony)

RTT, podobnie jak ping, mierzy czas potrzebny na przesłanie sygnału z urządzenia na serwer i z powrotem. Stanowi kluczowy wskaźnik latencji sieci. Narzędzia takie jak Wireshark mogą zapewnić szczegółowe pomiary RTT.

Aplikacje innych firm

Narzędzia takie jak iPerf i NetFlow Analyzer oferują bardziej szczegółowy wgląd w wydajność sieci. iPerf testuje przepustowość i opóźnienia między dwoma urządzeniami. NetFlow Analyzer na bieżąco analizuje ruch sieciowy.

Jak zmniejszyć latencję?

Wprowadzenie kilku przemyślanych zmian w konfiguracji sieci może istotnie przyczynić się do zmniejszenia opóźnień. Oto co możesz zrobić, aby błyskawicznie poprawić prędkość połączenia:

- Zmodernizuj urządzenia sieciowe – zaopatrz się w nowoczesny router i modem, a następnie umieść je w centralnym punkcie domu, aby uzyskać jak najlepszy zasięg. Regularne aktualizowanie oprogramowania sprzętowego poprawia wydajność i może rozwiązać problemy z latencją spowodowane przestarzałą technologią.

- Skorzystaj z połączenia przewodowego – używaj kabli Ethernet w przypadku urządzeń wymagających jak najniższej latencji, takich jak konsole do gier lub stacje robocze. Połączenia przewodowe eliminują wpływ ścian i innych urządzeń w pobliżu, które mogą pogarszać działanie Wi-Fi.

- Nadaj priorytet istotnym rodzajom ruchu – skonfiguruj Quality of Service (QoS) na routerze, aby nadać priorytet czynnościom wymagającym dużej przepustowości, takim jak granie online, wideorozmowy lub streaming. Dzięki temu niezbędne usługi mają zapewnioną przepustowość zawsze wtedy, gdy tego potrzebujesz.

- Ogranicz przeciążenie sieci – zmniejsz liczbę podłączonych urządzeń w okresach dużego obciążenia, zwłaszcza podczas streamingu lub grania. Aby odciążyć łącze, zaplanuj pobieranie dużych plików lub aktualizacje oprogramowania w godzinach o mniejszym natężeniu ruchu.

- Optymalizacja aplikacji – na bieżąco aktualizuj oprogramowanie i aplikacje, ponieważ może to skutkować poprawą prędkości i wydajności. Zamknij aplikacje działające w tle, które wykorzystują przepustowość, takie jak programy do aktualizacji automatycznej lub usługi streamingowe.

- Korzystaj z CDN (z ang. Content Delivery Network – sieć dostarczania zawartości) – jeśli posiadasz witrynę internetową, sieci CDN buforują treści zlokalizowane bliżej użytkowników, co przekłada się na krótszą drogę przesyłu danych i ograniczenie latencji. Wśród popularnych dostawców tego rodzaju usług można wymienić Cloudflare i Akamai. Mogą one skrócić czas wczytywania strony.

- Zgrupuj punkty końcowe sieci – uporządkuj urządzenia w logiczne grupy, aby zapewnić płynniejszy przepływ danych. Przykładowo, urządzenia do pracy można umieścić w innej grupie niż urządzenia do zastosowań rozrywkowych, co może poprawić wydajność przekierowywania i zmniejszyć opóźnienia między zgrupowanymi urządzeniami.

- Skorzystaj z metod kształtowania ruchu – zastosuj techniki kształtowania ruchu, aby zarządzać przepływem danych i nadawać priorytet najważniejszym zadaniom, takim jak streaming czy granie online. Kształtowanie ruchu zmniejsza przeciążenie sieci i zapewnia newralgicznym aplikacjom niską latencję.

- Połącz się z VPN – czasami wyższa latencja może wynikać z ograniczeń sieci lub dławienia (throttling) przez dostawcę usług internetowych. Na szczęście VPN maskuje połączenie, dzięki czemu nikt nie jest w stanie zobaczyć, co robisz online.

Inne czynniki wpływające na wydajność sieci

Czasami poprawa latencji nie wystarczy, by zagwarantować płynne połączenie. Oto inne czynniki wpływające na wydajność sieci i komfort korzystania z Internetu:

Przepustowość

Przepustowość to rzeczywista ilość danych przesyłanych przez sieć, często mniejsza niż szerokość pasma z powodu przeciążenia lub ograniczeń sprzętowych. Pokazuje, jak szybko działa połączenie. Niska przepustowość wskazuje na występowanie wąskiego gardła, dlatego warto ją monitorować w celu wykrycia przyczyn występowania opóźnień.

Jitter

Jitter występuje, gdy pakiety danych nie docierają w stałym tempie. Może to powodować zakłócenia w połączeniach wideo lub klatkowanie w grach. Wysoka wartość jitteru zakłóca aktywności wymagające płynnego przepływu danych w czasie rzeczywistym. Ograniczanie jitteru sprawia, że obraz w filmach i grach jest stabilniejszy i bardziej naturalny.

Czas rozwiązywania DNS

Określa czas potrzebny na przetłumaczenie adresu internetowego na adres IP, co jest niezbędnym etapem ładowania strony przez przeglądarkę. Jeśli czas rozwiązywania jest dłuższy, strony ładują się wolniej. Przełączenie się na szybszego dostawcę DNS, takiego jak Google DNS, może sprawić, że przeglądanie stron internetowych będzie szybsze i płynniejsze.

Moc i jakość sygnału

Wydajność sieci Wi-Fi zależy od mocy sygnału, na co wpływ mają: odległość, ściany i zakłócenia powodowane przez inne urządzenia. Słaby sygnał przekłada się na niższe prędkości i zrywanie połączeń. Aby poprawić jakość sygnału, umieść router w centralnym punkcie, unikaj zakłóceń, a w razie potrzeby zaopatrz się we wzmacniacz Wi-Fi.

Topologia sieci

Topologia to po prostu układ urządzeń w sieci. Im więcej połączeń i „przeskoków” muszą wykonać dane, tym wolniej wszystko działa. Grupowanie podobnych urządzeń i ograniczanie niepotrzebnych połączeń może przyspieszyć przesyłanie danych w sieci.

Narzut protokołu

Są to dodatkowe informacje umieszczane w pakietach danych na potrzeby ułatwienia przekierowywania i zapewnienia stabilności działania. Dodatkowe dane mogą obniżyć prędkość transferu, szczególnie w przypadku większych plików. Dostosowanie ustawień sieciowych w celu zminimalizowania narzutu może pomóc przyspieszyć działania wymagające dużej przepustowości.

Często zadawane pytania dot. latencji

Co oznacza termin „latencja”?

Latencja to czas potrzebny na przesłanie danych z urządzenia do miejsca docelowego i z powrotem. Mierzy się ją w milisekundach i wpływa na szybkość uzyskiwania odpowiedzi online. Niższa latencja przekłada się na szybszą komunikację, co jest ważne w przypadku takich aktywności jak gry i wideorozmowy.

Czy latencja, ping i jitter to to samo?

Nie, te terminy różnią się od siebie, ale są powiązane. Latencja to całkowity czas transmisji danych do miejsca docelowego i z powrotem. Latencję można mierzyć różnymi metodami, a najczęściej stosowanym rozwiązaniem jest ping. Mierzy czas, jaki dane potrzebują, by opuścić urządzenie i na nie wrócić. Jitter odnosi się do zmienności czasu dostarczenia pakietów, co może powodować problemy w aplikacjach działających w czasie rzeczywistym.

Jaki poziom latencji nadaje się do grania?

Do grania online najlepiej nadaje się latencja poniżej 20 ms, choć wartości w zakresie 20-50 ms uznaje się za akceptowalne. Oto optymalne wartości latencji dla innych czynności, takich jak wideorozmowy, streaming, pobieranie plików i korzystanie z aplikacji w chmurze.

Podsumowanie

Wiedząc już, co wpływa na sieć, możesz poprawić komfort korzystania z Internetu. Nie musisz godzić się na niskie prędkości. Dzięki lepszemu zrozumieniu latencji i czynników sieciowych możesz wprowadzić konkretne zmiany, które zmniejszą opóźnienia, zwiększą wydajność i zagwarantują bezpieczeństwo online.

Uzyskanie optymalnej równowagi między prędkością i bezpieczeństwem nie musi wiązać się ze skomplikowaną konfiguracją. Optymalizując sprzęt sieciowy i przepływ ruchu, możesz uniknąć opóźnień.

Zostaw komentarz

Anuluj odpowiedź